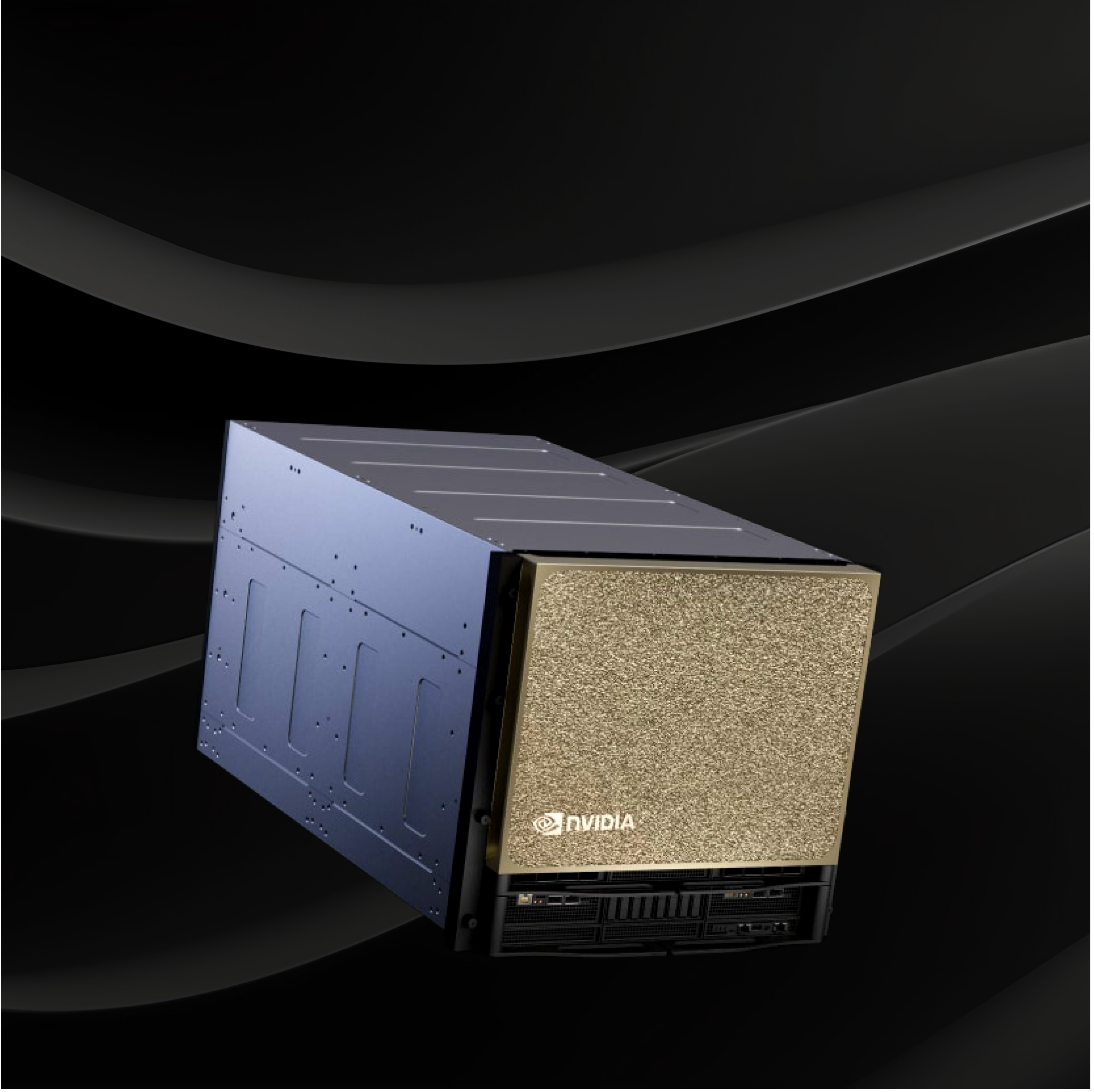

DGX B300

고확장성 AI 서버 플랫폼

LLM 추론을 위한 AI 팩토리

LLM 추론을 위한 AI 팩토리

| NVIDIA DGX B300 Technical Specifications | |

|---|---|

| GPUs | 8x NVIDIA Blackwell Ultra SXM |

| CPU | Intel® Xeon® 6776P Processors |

| Toal GPU Memory | 2.1 TB |

| Performance | FP4 Tensor Core: 144 PFLOPS | 108 PFLOPS* FP8 Tensor Core: 72 PFLOPS | 54 PFLOPS** |

| NVIDIA NVLink™ Switch System | 2x |

| NVIDIA NVLink Bandwidth | 14.4 TB/s aggregate bandwidth |

| Networking |

8x OSFP ports serving 8x single-port NVIDIA ConnectX-8 VPI > > Up to 800 Gb/s NVIDIA InfiniBand/Ethernet 2x dual-port QSFP112 NVIDIA BlueField-3 DPU > > Up to 400 Gb/s NVIDIA InfiniBand/Ethernet |

| Management Network | 1GbE onboard NIC with RJ45 1GbE RJ45 Host baseboard management controller (BMC) |

| Storage |

OS: 2x 1.9 TB NVMe M.2 Internal storage: 8x 3.84 TB NVMe E1.S |

| System Power | 14.5 kW (Busbar) / 15.1 kW (PSU) |

| Software |

NVIDIA AI Enterprise (optimized AI software) NVIDIA Mission Control (AI data center operations and orchestration with NVIDIA Run:ai technology) NVIDIA DGX OS (operating system) Supports Red Hat Enterprise Linux / Rocky / Ubuntu |

| Rack Units | 10U |

| Support | Three-year business-standard hardware and software support |